La ética y la moral para que las máquinas seleccionen su víctimas autónomamente.

Se dice que no existen actualmente robots asesinos autónomos, pero los avances en la tecnología los están comenzando a hacer posible, y con ello viene el tema de la ética y la moral de estas máquinas de matar para seleccionar sus blancos.

La preocupación por los drones y los robots están finalmente está llegando a las fuerzas armadas y a la ONU, tras una serie de advertencias de destacados científicos e investigadores.

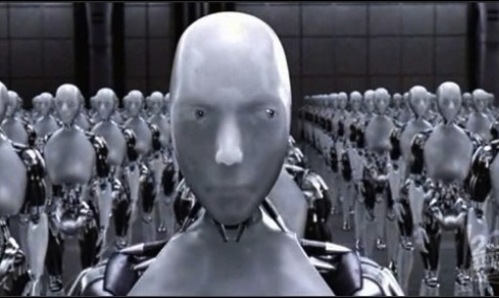

Tal vez el mayor signo de que estamos en un punto de inflexión hacia la guerra robótica es el desarrollo anunciado de los robots asesinos autónomos (killer robots), que pueden seleccionar autónomamente sus víctimas.

Los drones con armas están proliferando en todo el planeta a un ritmo rápido, lo que ha llevado a los investigadores militares a la conclusión de que todos los países tendrán drones armados dentro de 10 años. Aunado a esto, están los avances en la robótica y la inteligencia artificial que pretende literalmente dar vida y autonomía a nuestras creaciones robóticas. Hay un movimiento en marcha en el área de la inteligencia artificial que está introduciendo incluso la supervivencia de los más aptos a los robots en un esfuerzo para crear un rival de la naturaleza.

FUNCIÓN ASESINA AUTÓNOMA

Un robot asesino es un arma completamente autónoma que puede seleccionar y atacar objetivos sin ninguna intervención humana. Se dice que no existen en la actualidad, pero los avances en la tecnología están cada vez más cerca de esa realidad.

Los partidarios de robots asesinos creen que las actuales leyes de la guerra pueden ser suficientes para hacer frente a cualquier problema que pudiera surgir en caso de que sean desplegados, con el argumento de que se debe llamar a una moratoria, y no a una prohibición total, si este no es el caso.

Sin embargo, aquellos que se oponen a su uso creen que son una amenaza para la humanidad y todas las «funciones asesinas» autónomas deberían prohibirse.

«Los sistemas de armas autónomas no pueden garantizar que cumplan previsiblemente con el derecho internacional», dijo el profesor Sharkey a la BBC. «Las naciones no están hablando entre sí acerca de esto, lo que supone un gran riesgo para la humanidad.»

El profesor Sharkey es miembro y co-fundador de la Campaña contra Killer Robots y presidente del Comité Internacional para el Control de Armas Robot.

Por su parte, el Profesor Arkin del Instituto de Tecnología de Georgia dijo a la BBC que esperaba que los robots asesinos pudieran reducir significativamente las bajas no combatientes, pero temía que se lancen al combate antes de que esto se logre.

«Estoy a favor de una moratoria hasta que se logre ese fin, pero yo no apoyo una prohibición en este momento», dijo el profesor Arkin.

Él llegó a afirmar que los robots asesinos pueden estar en mejores condiciones para determinar cuándo no atacar a un blanco que los humanos y podrían llegar a ejercer un mayor cuidado al hacerlo.

El profesor Sharkey es menos optimista. «Estoy preocupado por la automatización completa de la guerra», dice.

LA ÉTICA Y LA MORAL DE LA AUTONOMÍA

Ante esta discusión creciente, el Departamento de Defensa de EE.UU., en colaboración con los científicos de computadoras, filósofos y especialistas en robótica de varias universidades de Estados Unidos, han comenzado un proyecto que abordará el delicado tema de la moral y ética de los robots.

Este proyecto multidisciplinario primero tratará de precisar con exactitud lo que es la moralidad humana y, a continuación, tratar de diseñar algoritmos informáticos que imbuyan a los robots autónomos competencia moral – la capacidad de elegir entre el bien y el mal. A medida que avanzamos constantemente hacia una fuerza militar poblada por robots autónomos, cada vez es más importante dar a estas máquinas la capacidad de tomar la decisión correcta.

¿Está bien que un soldado robot dispare a los enemigos? ¿Y si el enemigo es un niño? ¿Debería un dron autónomo hacer estallar un puñado de terroristas? ¿Y si es sólo 90% seguro de que sean terroristas, con una probabilidad del 10% que sólo sean aldeanos inocentes? ¿Qué haría un piloto humano en este caso? ¿Los robots sólo tienen que coincidir con la competencia moral y ética de los seres humanos, o van a llegar a un nivel superior?

Se podría argumentar que la asignación de los militares para ser el árbitros de lo que es la moral podría ser absurda.

Se necesita transparencia sobre quienes son los especialistas en ética que están ayudando a dar orientación acerca de la moralidad. El hecho de que uno se haga llamar un especialista en ética, o tenga un título de una universidad importante, no descarta la psicopatía. Para muestra un botón, por favor, lea este artículo acerca de un especialista universitario en ética que cree en la extensión de la vida sólo como un medio para ofrecer el tormento eterno para aquellos considerados por el sistema de justicia que son los peores delincuentes.

Sin embargo, al menos la discusión finalmente se pone sobre la mesa de la ONU.

SE DEBATIRÁ EN LA ONU ESTA SEMANA

El tema de los robots asesinos se debatirá en una reunión informal de expertos en las Naciones Unidas en Ginebra. Dos expertos en robótica, el profesor Ronald Arkin y el profesor Noel Sharkey, debatirán sobre la eficacia y la necesidad de robots asesinos.

La reunión se llevará a cabo durante la Convención de la ONU sobre Ciertas Armas Convencionales (CCW). Esta será la primera vez que el tema de robots asesinos, o sistemas de armas letales autónomas, se abordará dentro de la CCW.

La reunión de expertos estará presidido por el embajador francés Jean-Hugues Simon-Michel del 13 al 16 mayo de 2014.

Fuentes: BBC, Activist Post, Signos de estos Tiempos

|